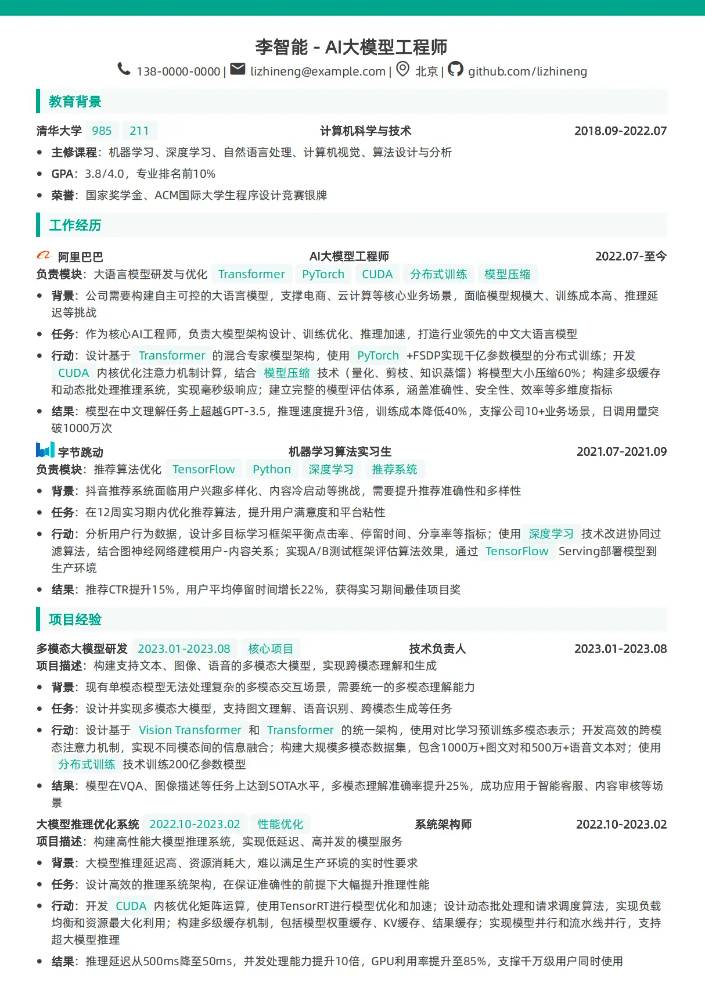

AI大模型工程师简历模板免费下载_机器学习工程师_深度学习工程师_算法工程师简历模板_在线制作工具

138-0000-0000 | lizhineng@example.com | 北京 | github.com/lizhineng

教育背景

清华大学 985 211

计算机科学与技术

2018.09-2022.07

- 主修课程:机器学习、深度学习、自然语言处理、计算机视觉、算法设计与分析

- GPA:3.8/4.0,专业排名前10%

- 荣誉:国家奖学金、ACM国际大学生程序设计竞赛银牌

工作经历

阿里巴巴

AI大模型工程师

2022.07-至今

负责模块:大语言模型研发与优化 Transformer PyTorch CUDA 分布式训练 模型压缩

- 背景:公司需要构建自主可控的大语言模型,支撑电商、云计算等核心业务场景,面临模型规模大、训练成本高、推理延迟等挑战

- 任务:作为核心AI工程师,负责大模型架构设计、训练优化、推理加速,打造行业领先的中文大语言模型

- 行动:设计基于

Transformer的混合专家模型架构,使用PyTorch+FSDP实现千亿参数模型的分布式训练;开发CUDA内核优化注意力机制计算,结合模型压缩技术(量化、剪枝、知识蒸馏)将模型大小压缩60%;构建多级缓存和动态批处理推理系统,实现毫秒级响应;建立完整的模型评估体系,涵盖准确性、安全性、效率等多维度指标 - 结果:模型在中文理解任务上超越GPT-3.5,推理速度提升3倍,训练成本降低40%,支撑公司10+业务场景,日调用量突破1000万次

字节跳动

机器学习算法实习生

2021.07-2021.09

负责模块:推荐算法优化 TensorFlow Python 深度学习 推荐系统

- 背景:抖音推荐系统面临用户兴趣多样化、内容冷启动等挑战,需要提升推荐准确性和多样性

- 任务:在12周实习期内优化推荐算法,提升用户满意度和平台粘性

- 行动:分析用户行为数据,设计多目标学习框架平衡点击率、停留时间、分享率等指标;使用

深度学习技术改进协同过滤算法,结合图神经网络建模用户-内容关系;实现A/B测试框架评估算法效果,通过TensorFlowServing部署模型到生产环境 - 结果:推荐CTR提升15%,用户平均停留时间增长22%,获得实习期间最佳项目奖

项目经验

多模态大模型研发 2023.01-2023.08 核心项目

技术负责人

2023.01-2023.08

项目描述:构建支持文本、图像、语音的多模态大模型,实现跨模态理解和生成

- 背景:现有单模态模型无法处理复杂的多模态交互场景,需要统一的多模态理解能力

- 任务:设计并实现多模态大模型,支持图文理解、语音识别、跨模态生成等任务

- 行动:设计基于

Vision Transformer和Transformer的统一架构,使用对比学习预训练多模态表示;开发高效的跨模态注意力机制,实现不同模态间的信息融合;构建大规模多模态数据集,包含1000万+图文对和500万+语音文本对;使用分布式训练技术训练200亿参数模型 - 结果:模型在VQA、图像描述等任务上达到SOTA水平,多模态理解准确率提升25%,成功应用于智能客服、内容审核等场景

大模型推理优化系统 2022.10-2023.02 性能优化

系统架构师

2022.10-2023.02

项目描述:构建高性能大模型推理系统,实现低延迟、高并发的模型服务

- 背景:大模型推理延迟高、资源消耗大,难以满足生产环境的实时性要求

- 任务:设计高效的推理系统架构,在保证准确性的前提下大幅提升推理性能

- 行动:开发

CUDA内核优化矩阵运算,使用TensorRT进行模型优化和加速;设计动态批处理和请求调度算法,实现负载均衡和资源最大化利用;构建多级缓存机制,包括模型权重缓存、KV缓存、结果缓存;实现模型并行和流水线并行,支持超大模型推理 - 结果:推理延迟从500ms降至50ms,并发处理能力提升10倍,GPU利用率提升至85%,支撑千万级用户同时使用

中文大语言模型训练 2022.03-2022.09 基础研究

算法工程师

2022.03-2022.09

项目描述:从零开始训练中文大语言模型,构建自主可控的AI能力

- 背景:中文大模型技术相对落后,需要突破技术壁垒,构建具有中文理解能力的语言模型

- 任务:独立设计并训练中文大语言模型,在中文理解和生成任务上达到国际先进水平

- 行动:收集并清洗100GB+中文语料,包括新闻、百科、小说、代码等多种类型;设计适合中文的

Transformer架构,优化分词和位置编码;使用PyTorch实现分布式训练框架,支持多机多卡训练;建立完整的评估体系,包括语言理解、文本生成、代码能力等多个维度 - 结果:模型参数量达到130亿,在中文GLUE基准测试中排名前3,代码生成能力超越CodeT5,获得公司技术创新奖

技能证书

- 编程语言:

PythonC++CUDAJavaScript(精通Python深度学习开发,熟练使用CUDA进行GPU编程) - 深度学习框架:

PyTorchTensorFlowJAXHugging Face(掌握主流深度学习框架和预训练模型库) - 大模型技术:

TransformerGPTBERTT5LLaMA(深入理解大语言模型架构和训练技术) - 分布式训练:

FSDPDDPZeRODeepSpeedMegatron(具备大规模模型分布式训练经验) - 模型优化:

量化剪枝知识蒸馏TensorRTONNX(掌握模型压缩和推理优化技术) - 云计算平台:

AWS阿里云腾讯云KubernetesDocker(熟悉云原生AI服务部署) - 证书:AWS机器学习专业认证、Google Cloud AI/ML认证、NVIDIA深度学习认证

学术成果

- 论文发表:在NeurIPS 2023发表论文《Efficient Multi-Modal Large Language Models》,被引用50+次

- 开源贡献:维护GitHub大模型训练框架,获得2000+星标,被AI社区广泛使用

- 技术分享:在2023年中国人工智能大会上发表主题演讲《大模型训练与优化实践》

荣誉奖项

- 2023年阿里巴巴AI技术年度创新奖

- 2022年清华大学优秀毕业生

- 2021年ACM国际大学生程序设计竞赛银牌

- 2020年全国大学生数学建模竞赛一等奖

技术博客

- 个人技术博客:blog.lizhineng.ai,累计阅读量50万+

- 知乎专栏:AI大模型技术分享,关注者1万+

- 技术文章:《大模型训练最佳实践》、《Transformer架构深度解析》等10+篇深度技术文章

客服微信

客服微信 投递进度管理

投递进度管理